Existe una aplicación que puede suponer un riesgo para muchas personas, ya que mediante la tecnología deepfake, suplanta la identidad de cualquier persona para meterla en un video porno. Estos datos pertenecen a un informe de MIT Review que no ha querido desvelar el nombre de la plataforma, para así evitar que otros usuarios se sumen a este delito. El investigador Henry Ajder descubrió el uso de esta aplicación, para ello ha seguido la evolución y el auge de los medios sintéticos en línea.

“Sobre un fondo blanco, un botón azul gigante invita a los visitantes a subir una foto de un rostro”

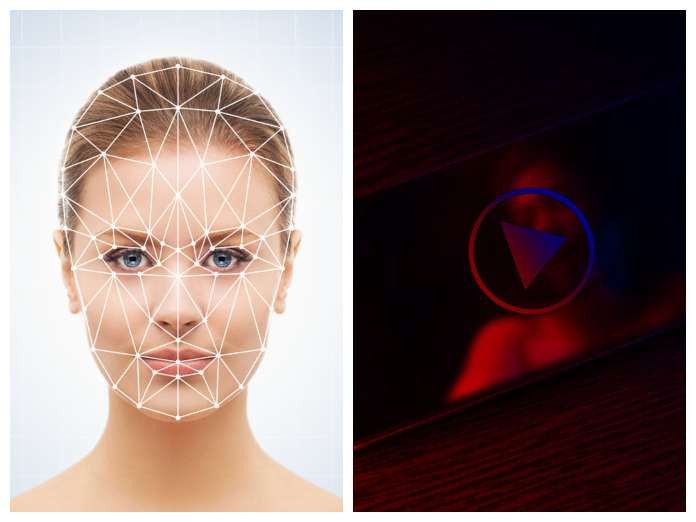

En cuanto al mecanismo de esta aplicación, MIT Review ha explicado que “sobre un fondo blanco, un botón azul gigante invita a los visitantes a subir una foto de un rostro. Debajo del botón, cuatro caras generadas por IA le permiten probar el servicio. Por encima de él, el eslogan proclama audazmente el propósito: convertir a cualquiera en una estrella del porno mediante el uso de tecnología deepfake para cambiar la cara de la persona por un video para adultos. Todo lo que necesita es la imagen y presionar un botón”.

Un problema de este tipo de aplicaciones es la sencillez de su uso. Una vez que un usuario carga una foto de una cara, el sitio abre una biblioteca de videos porno. La mayoría presenta mujeres, aunque un pequeño puñado también presenta hombres, principalmente en el porno gay. Luego, un usuario puede seleccionar cualquier video para generar una vista previa del resultado del intercambio de caras en segundos y pagar para descargar la versión completa.

Vídeos y audios deepfake, un paso más hacia el engaño en las redes sociales

Leer más

Tecnología deepfake

Por otro lado, MIT Review ha señalado que no es la primera vez que se usan deepfakes o herramientas generados por la inteligencia artificial para generar representaciones pornográficas de víctimas. Esta compañía predice que entre el 90% y 95% de todos los videos deepfake en línea son pornografía no consensuada, y aproximadamente el 90% de esos vídeos incluyen mujeres.

Tinder apuesta por la verificación de identidad a nivel global

Leer más

“Este tipo de abuso, donde la gente tergiversa su identidad, nombre, reputación y la alteran de formas tan violentas, lo destroza hasta la médula”

En esta línea, Noelle Martin, una activista australiana que ha estado involucrada en una campaña de pornografía deepfake, ha declarado que “este tipo de abuso, donde la gente tergiversa su identidad, nombre, reputación y la alteran de formas tan violentas, lo destroza hasta la médula”. Además, cabe destacar que en países donde la homosexualidad está perseguida, la vida de algunos hombres puede estar en peligro si se les involucra en un vídeo porno.

Qué información se necesita para distinguir a una persona entre miles de millones

Leer más

Asimismo, hay herramientas que los usuarios pueden utilizar para quitarle la ropa a las mujeres con las que fantaseen utilizando la inteligencia artificial. Se trata de herramientas de código abierto, disponibles en la red. Una de estas páginas tuvo más de 6,7 millones de visitas en agosto. Miles de mujeres son víctimas del porno deepfake sin ni siquiera saberlo.