La crisis de la salud mental infantil en España ya no se explica solo por factores sociales o familiares: se desarrolla, en gran medida, dentro del entorno digital. El último informe de la Fundación ANAR así lo demuestra: la tecnología interviene en el 62,7% de los casos atendidos, lo que convierte a plataformas, algoritmos y servicios online en un elemento estructural de riesgo.

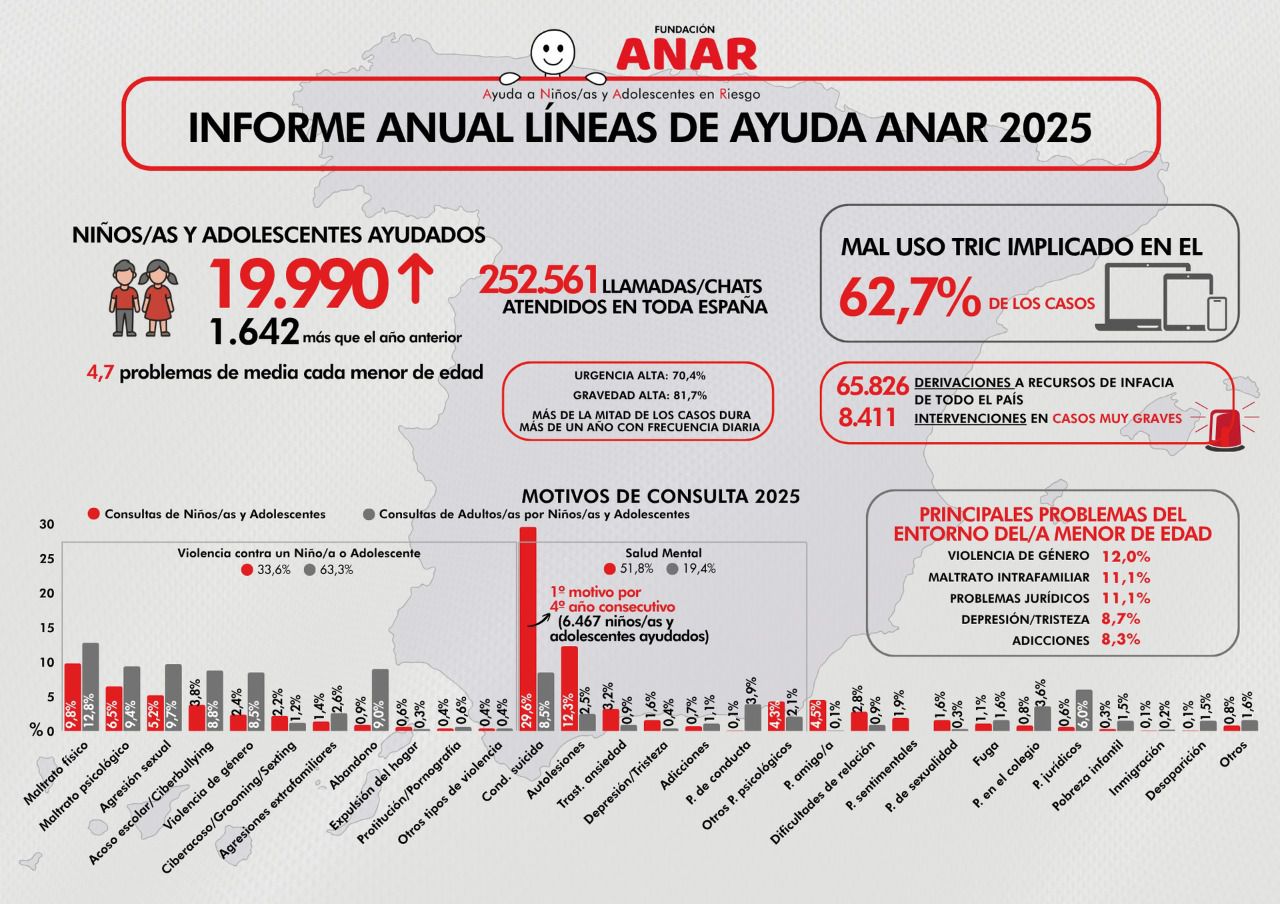

Las redes sociales, los sistemas de recomendación y los modelos de consumo de contenido configuran hoy el espacio donde se producen y amplifican muchas de las crisis emocionales de menores. Los datos respaldan esta evolución. La Fundación ANAR atendió a 19.990 menores en 2025, con un incremento del 8,9%, en un escenario donde la salud mental concentra más de la mitad de las consultas y la conducta suicida se mantiene como principal motivo. La complejidad de los casos, con una media de 4,7 problemas por menor, refuerza la idea de un fenómeno estructural en el que el entorno digital adquiere un peso determinante.

El entorno digital como arquitectura del problema

El dato más relevante del informe sitúa el foco en la tecnología. El uso inadecuado de entornos digitales aparece en el 62,7% de los casos, lo que indica que la crisis no solo se relaciona con el acceso a dispositivos, sino con la dinámica interna de las plataformas. En este sentido, las redes sociales y los servicios digitales funcionan como espacios donde se amplifican las vulnerabilidades. El ciberacoso, la exposición a contenidos autodestructivos o el contacto con perfiles de riesgo se integran en la experiencia cotidiana de los menores.

Además, la tecnología se configura como un refugio emocional en contextos de vulnerabilidad. Diana Díaz, directora de las Líneas de Ayuda ANAR, advierte que es necesario “que el refugio no sea la tecnología, donde pueden encontrarse con personas potencialmente peligrosas y contenidos nocivos que generan un alto impacto en su desarrollo”.

El entorno digital deja de ser un canal y se convierte en un ecosistema activo que modela la percepción del usuario

Asimismo, la lógica algorítmica de las plataformas introduce un elemento diferencial. Los sistemas de recomendación optimizan la permanencia del usuario mediante la repetición de contenidos afines, lo que genera entornos cerrados donde determinados discursos, incluidos aquellos relacionados con el malestar emocional o las autolesiones, adquieren visibilidad recurrente.

Como consecuencia, el entorno digital deja de ser un canal y se convierte en un ecosistema activo que modela la percepción del usuario. En edades tempranas, esta exposición continuada puede influir en la construcción de la identidad y en la normalización de determinadas conductas.

Algoritmos, atención y exposición: el núcleo tecnológico

Desde una perspectiva tecnológica, el problema se articula en torno a tres vectores: recomendación algorítmica, economía de la atención y diseño de interacción. En primer lugar, los algoritmos de recomendación priorizan contenidos con alta capacidad de retención, un criterio que favorece la viralización de contenidos emocionales intensos, incluidos aquellos vinculados a ansiedad, tristeza o autolesiones.

En segundo lugar, la economía de la atención impulsa diseños orientados a maximizar el tiempo de uso. Las plataformas incorporan notificaciones constantes, reproducción automática y scroll infinito, lo que dificulta la desconexión y prolonga la exposición a contenidos potencialmente sensibles.

El tercer vector es el diseño de interacción que refuerza la validación social a través de métricas visibles como “likes”, comentarios o reproducciones, una estructura que fomenta la comparación constante y aumenta la presión social, especialmente en perfiles adolescentes.

En este contexto, la combinación de estos elementos genera entornos donde el usuario además de consumir contenido, se integra en dinámicas de validación, exposición y repetición que afectan directamente a su bienestar emocional.

Limitaciones en control parental y moderación

La elevada implicación de la tecnología plantea interrogantes sobre la eficacia de los mecanismos de control actuales. Los sistemas de control parental ofrecen herramientas de supervisión, pero su implementación presenta barreras técnicas y culturales.

La fragmentación del ecosistema digital dificulta una gestión unificada, ya que los menores acceden a múltiples plataformas, cada una con sus propios sistemas de configuración, lo que complica el control efectivo del uso. Por otra parte, la moderación de contenidos se enfrenta a limitaciones estructurales. La escala de las plataformas y la velocidad de generación de contenido dificultan la identificación de materiales sensibles en tiempo real.

Asimismo, los sistemas automatizados de moderación presentan dificultades para interpretar contextos complejos, ya que contenidos relacionados con salud mental, ironía o experiencias personales pueden eludir los filtros o generar falsos positivos. En este sentido, el informe evidencia la necesidad de avanzar hacia modelos de supervisión más precisos, que combinen inteligencia artificial, intervención humana y criterios específicos para contenidos sensibles.